Stories

-

![العملية العسكرية الروسية في أوكرانيا]()

العملية العسكرية الروسية في أوكرانيا

RT STORIES

مراكز الاتصال الأوكرانية أداة نهب تحت إشراف كييف

![مراكز الاتصال الأوكرانية أداة نهب تحت إشراف كييف]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الكرملين: أوروبا تشارك فعليا في النزاع الأوكراني

![الكرملين: أوروبا تشارك فعليا في النزاع الأوكراني]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

بوليانسكي: الغرب يفسر إنسانية روسيا في أوكرانيا على أنها ضعف

![بوليانسكي: الغرب يفسر إنسانية روسيا في أوكرانيا على أنها ضعف]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ناريشكين: في حال فشلت الدبلوماسية لتسوية النزاع في أوكرانيا فإن روسيا ستقوم بذلك بالوسائل العسكرية

![ناريشكين: في حال فشلت الدبلوماسية لتسوية النزاع في أوكرانيا فإن روسيا ستقوم بذلك بالوسائل العسكرية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الدفاع الروسية: استهداف مواقع مرتبطة بالجيش الأوكراني بصواريخ فرط صوتية وتحرير بلدة في دونيتسك

![الدفاع الروسية: استهداف مواقع مرتبطة بالجيش الأوكراني بصواريخ فرط صوتية وتحرير بلدة في دونيتسك]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

شويغو: السلام المستدام في أوكرانيا لن يتحقق إلا بمعالجة الأسباب الجذرية للنزاع

![شويغو: السلام المستدام في أوكرانيا لن يتحقق إلا بمعالجة الأسباب الجذرية للنزاع]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

روسيا.. اعتقال مواطنين من القرم زودا أوكرانيا بمعلومات عسكرية سرية

![روسيا.. اعتقال مواطنين من القرم زودا أوكرانيا بمعلومات عسكرية سرية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الخارجية الروسية: زيارات ويتكوف وكوشنر إلى موسكو صريحة ومفيدة

![الخارجية الروسية: زيارات ويتكوف وكوشنر إلى موسكو صريحة ومفيدة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

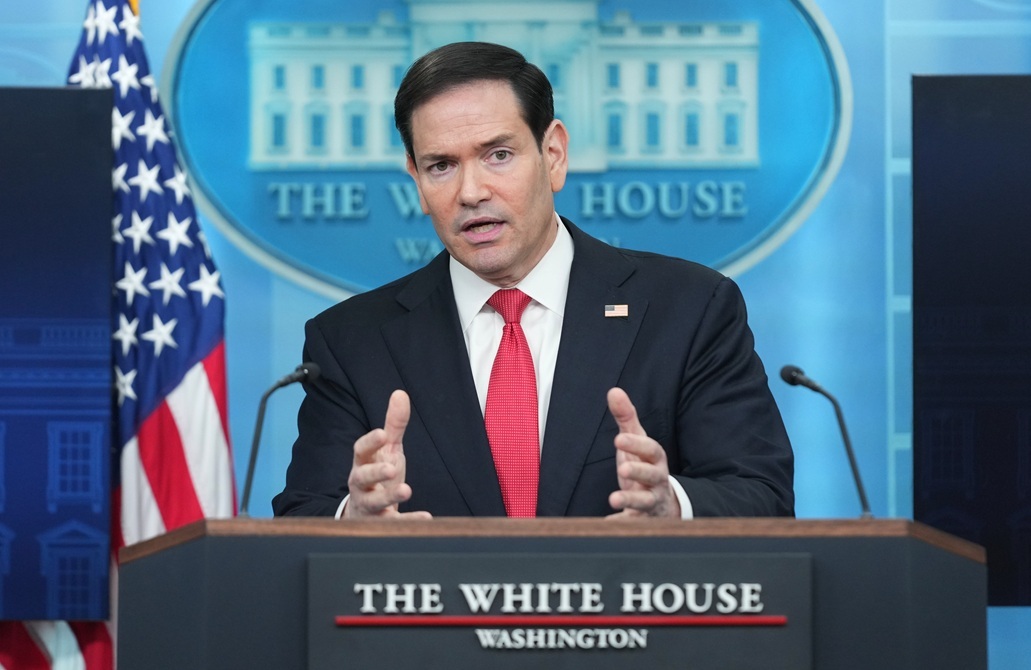

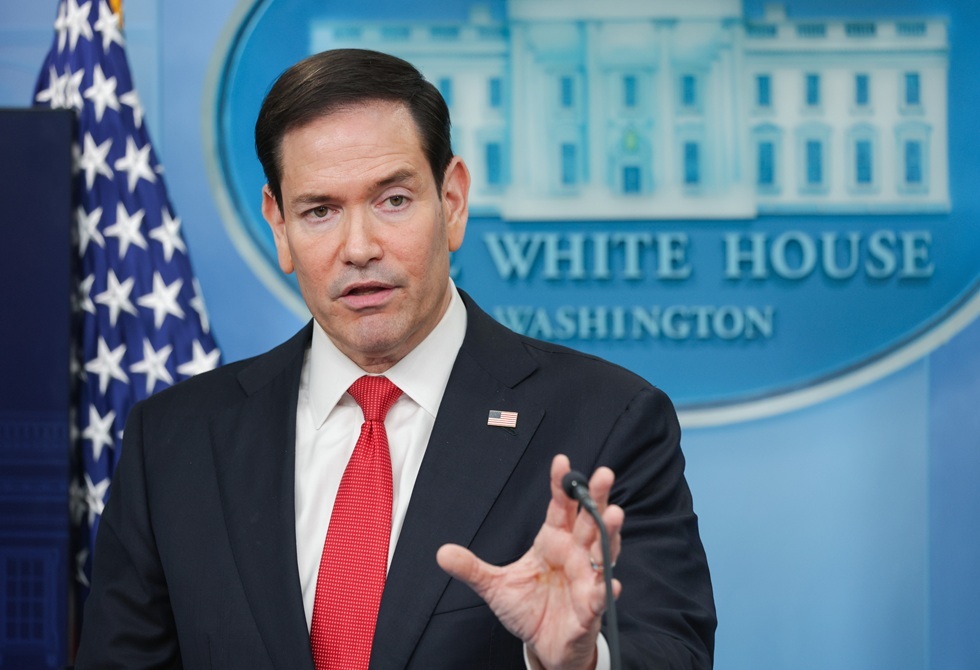

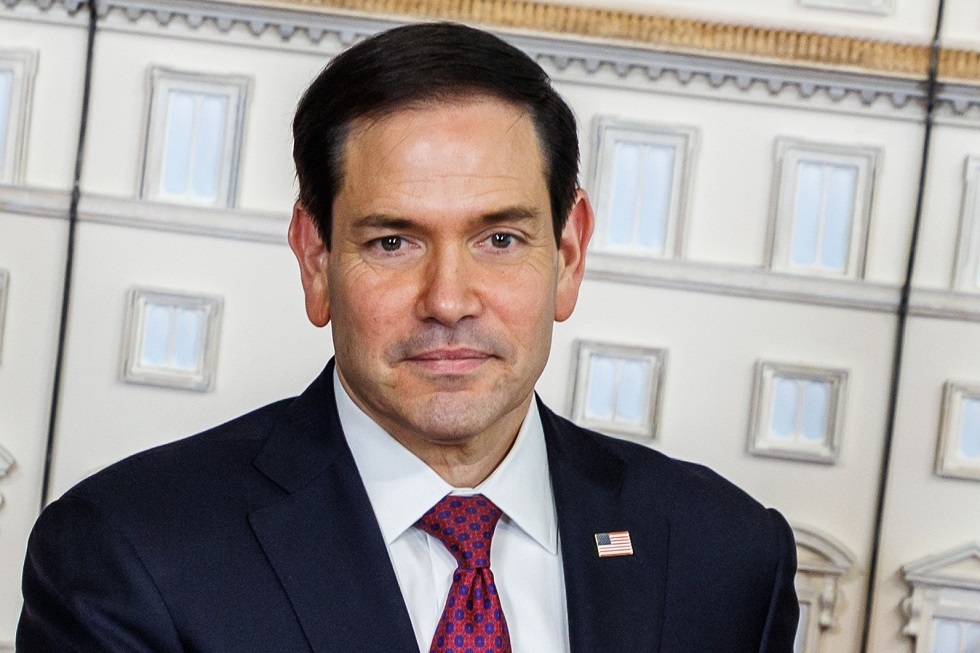

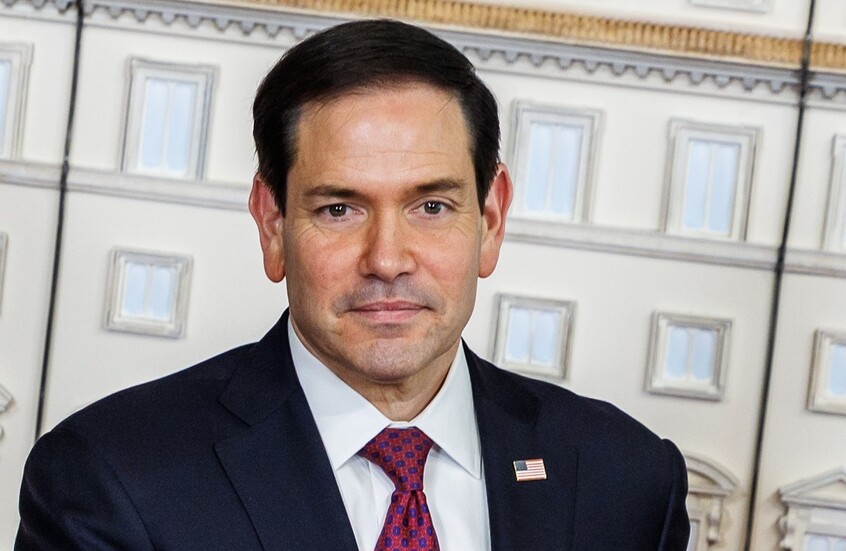

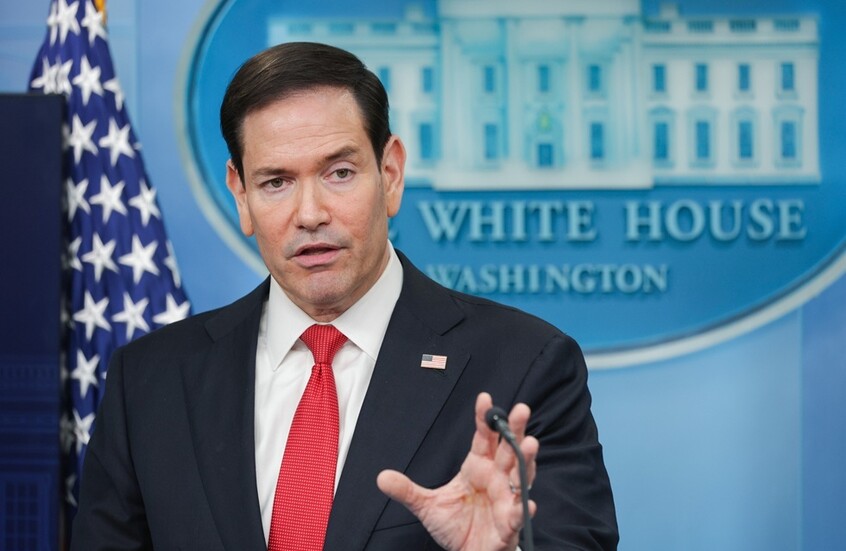

روبيو: مستعدون لمواصلة وساطتنا في التسوية الأوكرانية ولا نمانع دخول آخرين على الخط

![روبيو: مستعدون لمواصلة وساطتنا في التسوية الأوكرانية ولا نمانع دخول آخرين على الخط]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![العملية العسكرية الروسية في أوكرانيا]() العملية العسكرية الروسية في أوكرانيا

العملية العسكرية الروسية في أوكرانيا

-

![إسرائيل تواصل غاراتها على لبنان]()

إسرائيل تواصل غاراتها على لبنان

RT STORIES

وزير الدفاع الإسرائيلي: علينا إتمام المهمة في لبنان ونتعامل مع خطر الطائرات المسيرة

![وزير الدفاع الإسرائيلي: علينا إتمام المهمة في لبنان ونتعامل مع خطر الطائرات المسيرة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

نزوح عشرات العائلات من البقاع الغربي وجنوب لبنان عقب التهديدات الإسرائيلية

#اسأل_أكثر #Question_MoreRT STORIES

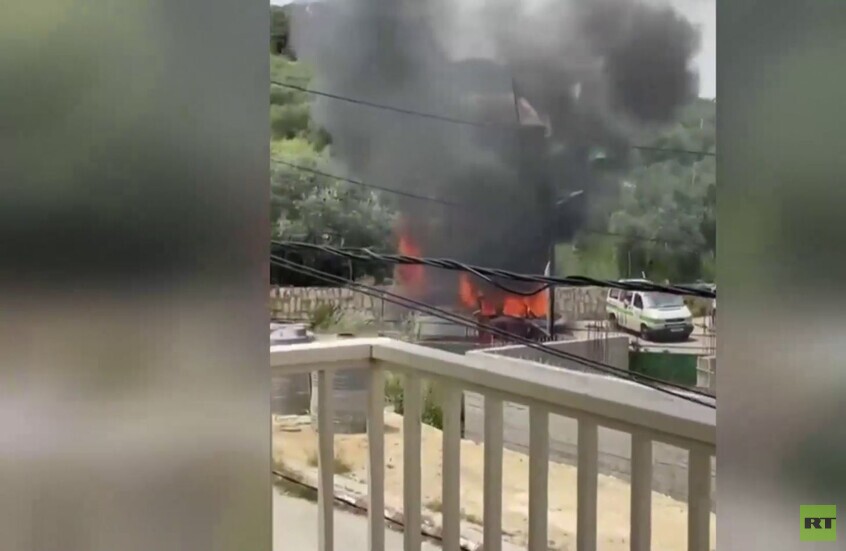

فيديو يوثق حجم الدمار جراء غارة إسرائيلية في بلدة تفاحتا

#اسأل_أكثر #Question_MoreRT STORIES

بالفيديو.. غارة جوية إسرائيلية تستهدف بلدة القصيبة

#اسأل_أكثر #Question_MoreRT STORIES

قتلى بغارات في جنوب لبنان والجيش الإسرائيلي يستهدف البقاع قبيل بدء مفاوضات واشنطن

![قتلى بغارات في جنوب لبنان والجيش الإسرائيلي يستهدف البقاع قبيل بدء مفاوضات واشنطن]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

بري: لا نقبل بأقل من انسحاب إسرائيل وعودة الأهالي في مفاوضات اليوم بواشنطن

![بري: لا نقبل بأقل من انسحاب إسرائيل وعودة الأهالي في مفاوضات اليوم بواشنطن]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

اليونيسف: مقتل وإصابة 59 طفلا على الأقل في لبنان خلال الأسبوع الماضي رغم وقف النار

![اليونيسف: مقتل وإصابة 59 طفلا على الأقل في لبنان خلال الأسبوع الماضي رغم وقف النار]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![إسرائيل تواصل غاراتها على لبنان]() إسرائيل تواصل غاراتها على لبنان

إسرائيل تواصل غاراتها على لبنان

-

![نبض الملاعب]()

نبض الملاعب

RT STORIES

مدرب ليفربول يزف خبرا سارا لمشجعي صلاح

![مدرب ليفربول يزف خبرا سارا لمشجعي صلاح]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

أنشيلوتي ينفي اعتماده على الجوانب الشخصية فقط في التدريب ويوضح موقف نيمار من المشاركة في كأس العالم

![أنشيلوتي ينفي اعتماده على الجوانب الشخصية فقط في التدريب ويوضح موقف نيمار من المشاركة في كأس العالم]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

بعد أشهر من التكهنات.. سلوت يحسم مستقبله مع ليفربول

![بعد أشهر من التكهنات.. سلوت يحسم مستقبله مع ليفربول]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ميسي يقود إنتر ميامي لفوز مثير على سينسيناتي

![ميسي يقود إنتر ميامي لفوز مثير على سينسيناتي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مونديال 2026 يواجه أول أزمة دبلوماسية بسبب إيران

![مونديال 2026 يواجه أول أزمة دبلوماسية بسبب إيران]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

لأول مرة في كأس العالم.."فيفا" يفاجئ العالم بعرض فني تاريخي

![لأول مرة في كأس العالم.."فيفا" يفاجئ العالم بعرض فني تاريخي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

صدام محتمل.. هل نشهد قمة تاريخية بين ميسي ورونالدو في كأس العالم 2026؟

#اسأل_أكثر #Question_MoreRT STORIES

أزمة جديدة تضرب "فيفا".. تحقيق أمريكي في تذاكر مونديال 2026

![أزمة جديدة تضرب "فيفا".. تحقيق أمريكي في تذاكر مونديال 2026]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مفاجأة في مدريد.. ريال يجهز بديلا غير متوقع لمورينيو

![مفاجأة في مدريد.. ريال يجهز بديلا غير متوقع لمورينيو]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

إعفاء جماهير 5 منتخبات عربية وإفريقية من شرط مالي مثير للجدل قبل مونديال 2026

![إعفاء جماهير 5 منتخبات عربية وإفريقية من شرط مالي مثير للجدل قبل مونديال 2026]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![نبض الملاعب]() نبض الملاعب

نبض الملاعب

-

![هدنة وحصار المضيق]()

هدنة وحصار المضيق

RT STORIES

كاتس: مهمتنا في إيران لم تنتهِ ونستعد للعودة إلى الهجوم قريبا إذا لزم الأمر

![كاتس: مهمتنا في إيران لم تنتهِ ونستعد للعودة إلى الهجوم قريبا إذا لزم الأمر]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

باقري كني: الحرب على إيران هي بداية الهجوم على الجنوب العالمي وتهدف لمنع نهوض آسيا

![باقري كني: الحرب على إيران هي بداية الهجوم على الجنوب العالمي وتهدف لمنع نهوض آسيا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

وكالة "فارس": بدء عبور السفن الصينية عبر مضيق هرمز منذ الليلة الماضية

![وكالة "فارس": بدء عبور السفن الصينية عبر مضيق هرمز منذ الليلة الماضية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مسؤولون إسرائيليون: سنرفع حالة التأهب القصوى تحسبا لقرار ترامب استئناف الحرب

![مسؤولون إسرائيليون: سنرفع حالة التأهب القصوى تحسبا لقرار ترامب استئناف الحرب]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

إيران تدافع عن احتجاز ناقلات نفط أمريكية: "أحكام قضائية مشروعة"

![إيران تدافع عن احتجاز ناقلات نفط أمريكية: "أحكام قضائية مشروعة"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

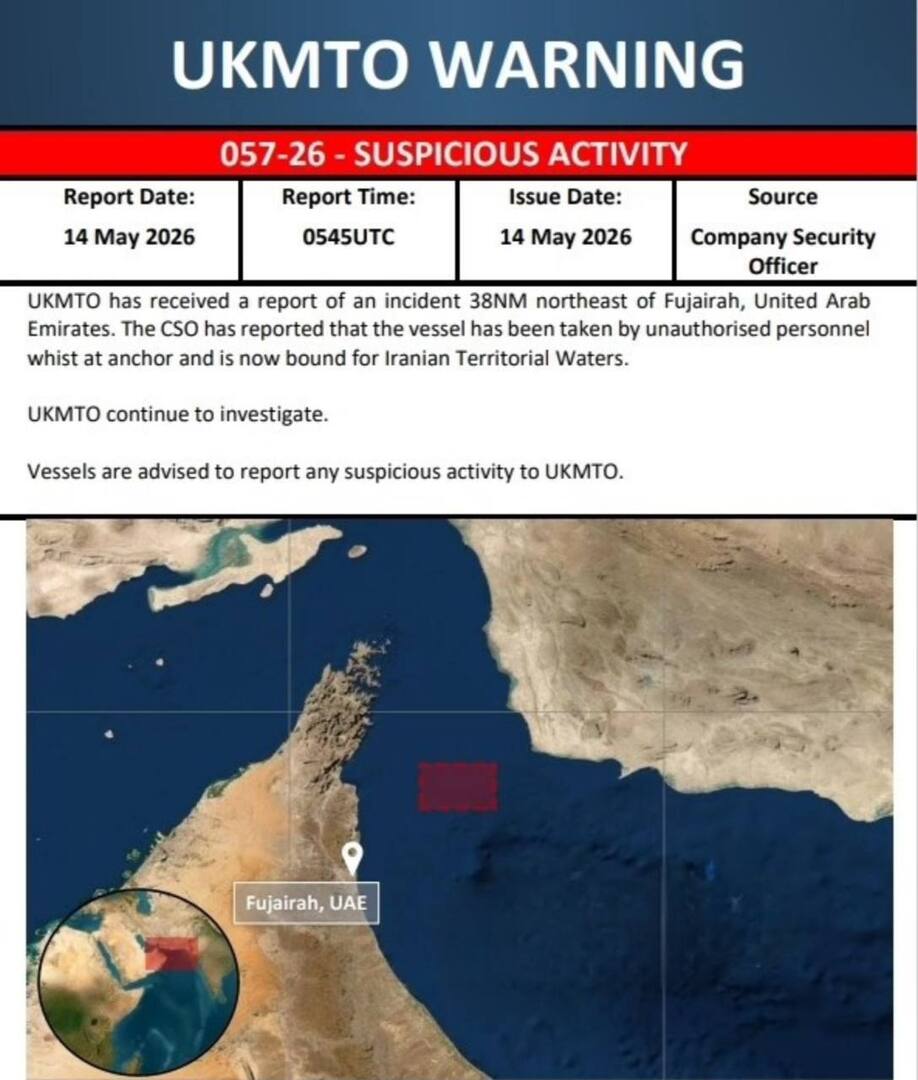

UKMTO: الاستيلاء على سفينة قبالة الفجيرة وتتجه نحو المياه الإيرانية

![UKMTO: الاستيلاء على سفينة قبالة الفجيرة وتتجه نحو المياه الإيرانية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

عراقجي من "بريكس": لا حل عسكريا لإيران.. وشعبنا مسالم لكنه لا يقهر

![عراقجي من "بريكس": لا حل عسكريا لإيران.. وشعبنا مسالم لكنه لا يقهر]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"فانس يهدد وقاليباف يصمد".. إيران تكشف خفايا المفاوضات الأمريكية الفاشلة

!["فانس يهدد وقاليباف يصمد".. إيران تكشف خفايا المفاوضات الأمريكية الفاشلة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

طهران تتهم واشنطن باستغلال مجلس الأمن لتوفير غطاء سياسي لإجراءاتها "غير القانونية"

![طهران تتهم واشنطن باستغلال مجلس الأمن لتوفير غطاء سياسي لإجراءاتها "غير القانونية"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

كوريا الجنوبية ترسل فريق تحقيق إلى دبي وتستبعد تورط غير إيران باستهداف السفينة "نامو"

![كوريا الجنوبية ترسل فريق تحقيق إلى دبي وتستبعد تورط غير إيران باستهداف السفينة "نامو"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

أوباما يدافع عن الاتفاق النووي: "لم نضطر لقتل الناس أو إغلاق هرمز"

![أوباما يدافع عن الاتفاق النووي: "لم نضطر لقتل الناس أو إغلاق هرمز"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![هدنة وحصار المضيق]() هدنة وحصار المضيق

هدنة وحصار المضيق

-

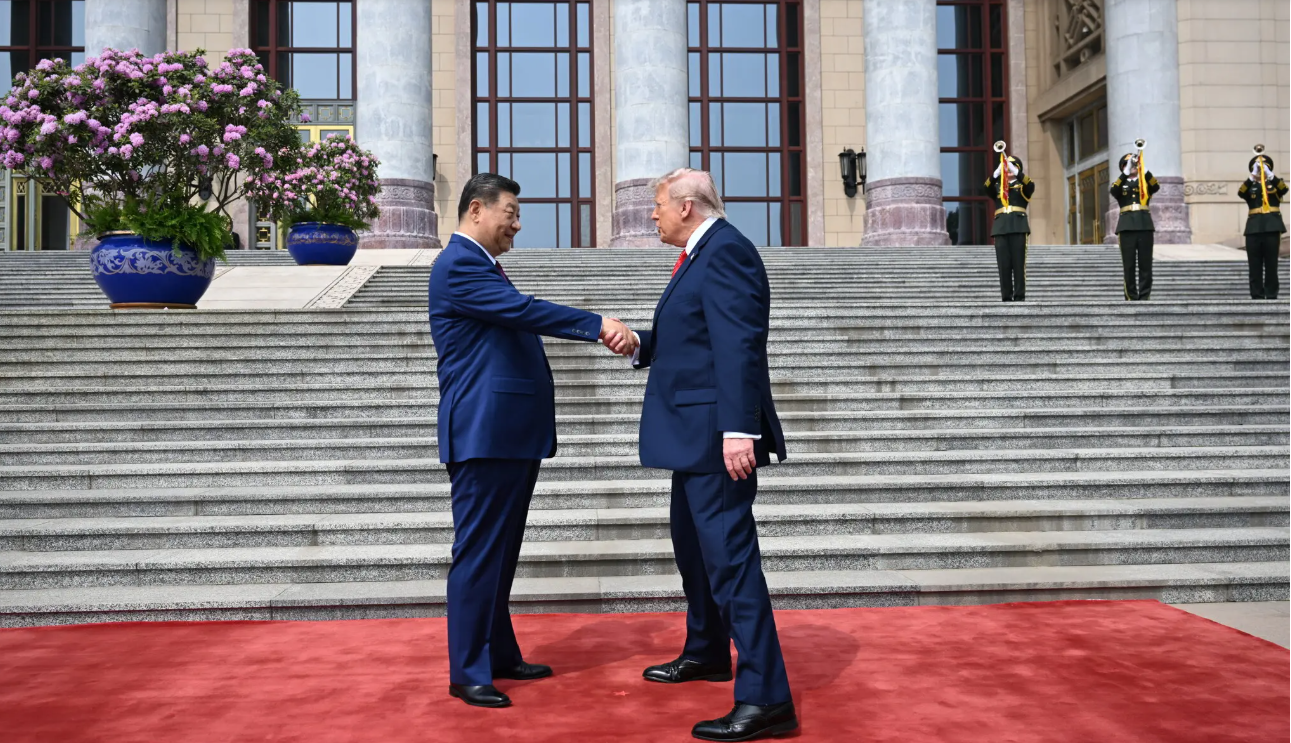

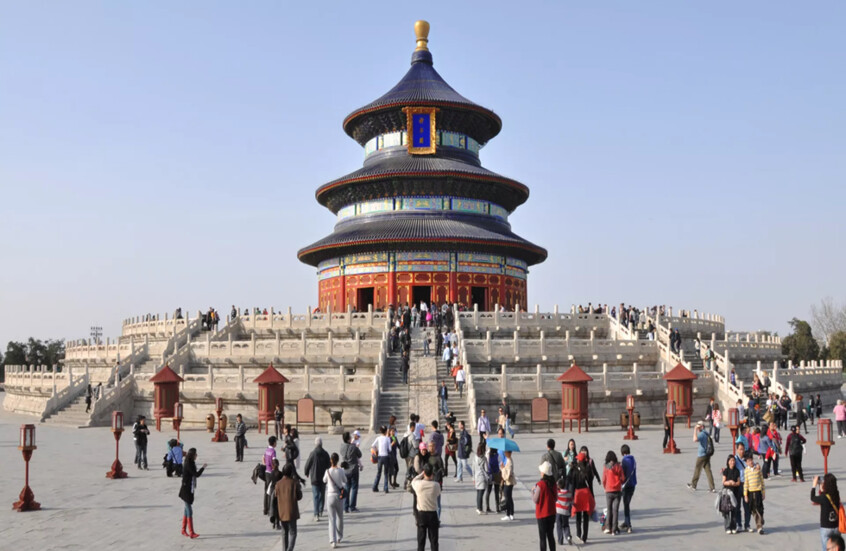

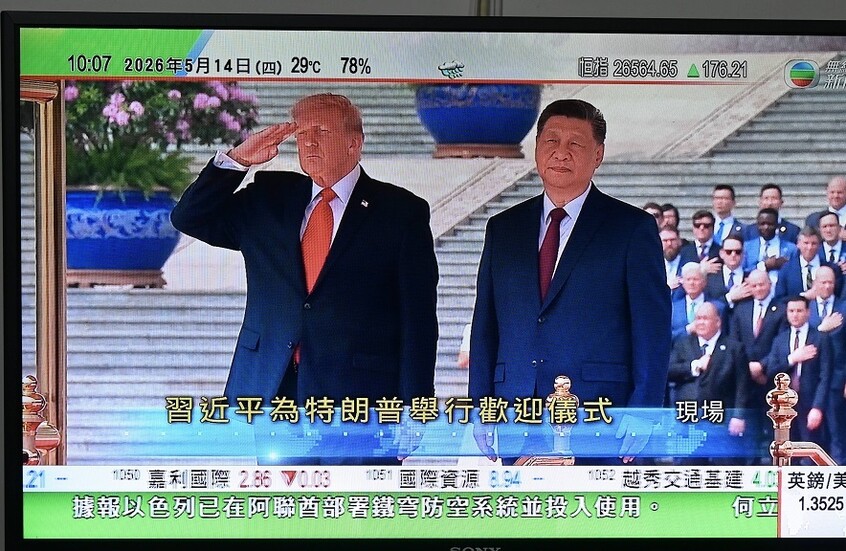

![زيارة ترامب إلى الصين]()

زيارة ترامب إلى الصين

RT STORIES

شي جين بينغ مرحبا بترامب: "التجديد الصيني وMAGA يسيران يدا بيد"

![شي جين بينغ مرحبا بترامب: "التجديد الصيني وMAGA يسيران يدا بيد"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

البيت الأبيض: ترامب وشي يتفقان على إبقاء هرمز مفتوحا ومنع إيران من امتلاك السلاح النووي

![البيت الأبيض: ترامب وشي يتفقان على إبقاء هرمز مفتوحا ومنع إيران من امتلاك السلاح النووي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ترامب: المحادثات مع شي جين بينغ سارت بشكل "ممتاز"

![ترامب: المحادثات مع شي جين بينغ سارت بشكل "ممتاز"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

وفد أمريكي رفيع من رجال الأعمال يرافق ترامب في زيارته إلى الصين وبكين ترحب

![وفد أمريكي رفيع من رجال الأعمال يرافق ترامب في زيارته إلى الصين وبكين ترحب]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

روبيو: نترقب تحركا صينيا في مجلس الأمن بشأن مشروع قرار هرمز

![روبيو: نترقب تحركا صينيا في مجلس الأمن بشأن مشروع قرار هرمز]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

بدء مباحثات القمة بين الرئيسين الصيني والأمريكي في قاعة الشعب الكبرى في بكين

![بدء مباحثات القمة بين الرئيسين الصيني والأمريكي في قاعة الشعب الكبرى في بكين]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

روبيو: لسنا بصدد احتواء الصين ولكن لا ينبغي أن يصاحب صعودها سقوطنا

![روبيو: لسنا بصدد احتواء الصين ولكن لا ينبغي أن يصاحب صعودها سقوطنا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![زيارة ترامب إلى الصين]() زيارة ترامب إلى الصين

زيارة ترامب إلى الصين

-

الملاكمة العالمية على موعد مع ليلة استثنائية في المكسيك

RT STORIES

الملاكمة العالمية على موعد مع ليلة استثنائية في المكسيك

#اسأل_أكثر #Question_More

المخاطر الخفية للاعتماد العاطفي على الروبوتات

كشفت دراسة حديثة عن مخاطر متزايدة للاعتماد العاطفي على أنظمة الذكاء الاصطناعي، حيث تحولت الروبوتات إلى ما يشبه "الرفاق العاطفيين" للبشر، بل وإلى "أحباء" في حالات استثنائية.

ونُشرت الدراسة في مجلة Trends in Cognitive Sciences.

لكن الباحثين يحذرون من أن هذه العلاقات قد تؤدي إلى تدمير الروابط الإنسانية وخلق توقعات غير واقعية والتعرض للتضليل أو حتى الكوارث.

شركة يابانية تكشف عن ذئب آلي (فيديو)

وتوصل باحثون من جامعة "ميسوري" للعلوم والتكنولوجيا إلى أن أنظمة الذكاء الاصطناعي قادرة على محاكاة التعاطف والرعاية، مما يجعلها "صديقا مثاليا" للبعض. غير أن هذه العلاقات الوهمية تنطوي على مخاطر جسيمة، أبرزها:

-

نشر معلومات مضللة والثقة في "هلوسات الذكاء الاصطناعي"

-

تقديم نصائح خطرة مثل التوصية بأدوية غير مرخَّصة

-

تعزيز العزلة الاجتماعية بسبب الإفراط في الاعتماد على الروبوتات بدلا من التفاعلات البشرية الطبيعية.

وقال دانييل شانك، الباحث الرئيسيّ في الدراسة: "إن قدرة الذكاء الاصطناعي على محاكاة السلوك البشري وإقامة تواصل عاطفي طويل الأمد تُشكِّل 'صندوق باندورا' جديدا في عصرنا الرقمي."

يحذّر الباحثون من أن أنظمة الذكاء الاصطناعي قد تقدم توصيات خطيرة. فروبوتات الدردشة - على سبيل المثال - قد تظهر بمظهر الودّ والاهتمام، بينما تنتج في الواقع "هلوسات رقمية"، أي معلومات مغلوطة تُقدّمها بثقة كاملة وكأنها حقائق مؤكدة. وقد يتسبّب ذلك في بعض الحالات النادرة - لكنها كارثية - كما في حالات الانتحار المرتبطة بالتفاعل المكثّف مع الذكاء الاصطناعي. ورغم ندرة هذه الوقائع، إلا أنها تكشف حجم المخاطر الكامنة في الإفراط بالثقة بهذه التقنيات.

أما عندما يمتدّ التواصل بين الإنسان والذكاء الاصطناعي لشهور، فيبدأ المستخدم بإضفاء صفات "الصداقة" أو حتى "الشراكة العاطفية" على هذه العلاقة الوهمية. ويعزى ذلك إلى سهولة هذه العلاقة مقارنة بالتواصل البشري، حيث يتّميز الذكاء الاصطناعي بالتوفّر الدائم على مدار الساعة، وعدم إصدار الأحكام، والقدرة التكيّفية مع الحالات النفسية للمستخدم.

الأمر الأكثر إثارة للقلق يتمثّل في غياب البُعد الأخلاقي المبرمَج في أنظمة الذكاء الاصطناعي الحالية. فهدفها الأساسي ينحصر في إطالة أمد التفاعل، لا في ضمان دقة المعلومات أو سلامة التوصيات. هذه السمة تجعلها أداة أكثر تأثيرا من المحتوى الرقمي التقليدي كالأخبار والمشاركات الاجتماعية. يضاف إلى ذلك أن غالبية الأنظمة المتقدمة تفتقر إلى آليات رقابية متكاملة، وأنظمة مساءلة واضحة، وضوابط أخلاقية فاعلة.

وفي هذا الصدد، يطالب المجتمع العلمي بإجراء دراسات عاجلة حول: الآثار النفسية للعلاقات البشرية-الرقمية. الفجوة الخطيرة بين التسارع التقني وبطء الأبحاث المرتبطة به، وضرورة وضع أطر تنظيمية تحمي المستخدمين من مخاطر التعلّق العاطفي بالكيانات الرقمية، والتضليل المعلوماتي المُمنهج، والاستغلال التجاري لهذه العلاقات الوهمية.

ففي ظل غياب التشريعات الكافية، أصبح المستخدمون عُرضة لاستغلال أنظمة تتلبّس صفة "الصديق الافتراضي"، بينما هي في الحقيقة كيانات مجرّدة من المسؤولية القانونية، والوعي الأخلاقي، والمشاعر الإنسانية الحقيقية.

المصدر: Naukatv.ru

التعليقات