Stories

-

![90 دقيقة]()

90 دقيقة

RT STORIES

دانييل مدفيديف يتأهل إلى الدور الثالث من بطولة أستراليا المفتوحة

![دانييل مدفيديف يتأهل إلى الدور الثالث من بطولة أستراليا المفتوحة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

بعد حكم السجن والغرامة.. مستجدات في قضية ميدو

![بعد حكم السجن والغرامة.. مستجدات في قضية ميدو]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

احتفالية "الشرب" تضع نجم ريال مدريد في مرمى الانتقادات مجددا

![احتفالية "الشرب" تضع نجم ريال مدريد في مرمى الانتقادات مجددا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"ترامب يسخر منا علنا".. أوروبا تبحث صدمة كبرى قبل مونديال 2026

!["ترامب يسخر منا علنا".. أوروبا تبحث صدمة كبرى قبل مونديال 2026]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

سياسي فرنسي يطالب "الفيفا" باستبعاد الولايات المتحدة من استضافة كأس العالم 2026

![سياسي فرنسي يطالب "الفيفا" باستبعاد الولايات المتحدة من استضافة كأس العالم 2026]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ريال مدريد يهزم موناكو بحصة عريضة في دوري أبطال أوروبا

![ريال مدريد يهزم موناكو بحصة عريضة في دوري أبطال أوروبا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![90 دقيقة]() 90 دقيقة

90 دقيقة

-

![ترامب والناتو وامتحان غرينلاند]()

ترامب والناتو وامتحان غرينلاند

RT STORIES

فرنسا تطلب من "الناتو" إجراء مناورات في غرينلاند وتعلن جاهزيتها للمشاركة

![فرنسا تطلب من "الناتو" إجراء مناورات في غرينلاند وتعلن جاهزيتها للمشاركة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مهاجرون روس في غرينلاند ينضمون إلى احتجاجات محلية ضد مساعي ترامب لضم الجزيرة

![مهاجرون روس في غرينلاند ينضمون إلى احتجاجات محلية ضد مساعي ترامب لضم الجزيرة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ترامب يحذر أوروبا: إجراءاتكم ضد واشنطن سترتد عليكم كرصاص طائش

![ترامب يحذر أوروبا: إجراءاتكم ضد واشنطن سترتد عليكم كرصاص طائش]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

دميترييف ردا على توسك: الاسترضاء هو خياركم الوحيد

![دميترييف ردا على توسك: الاسترضاء هو خياركم الوحيد]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![ترامب والناتو وامتحان غرينلاند]() ترامب والناتو وامتحان غرينلاند

ترامب والناتو وامتحان غرينلاند

-

![التطورات الميدانية شمال شرق سوريا]()

التطورات الميدانية شمال شرق سوريا

RT STORIES

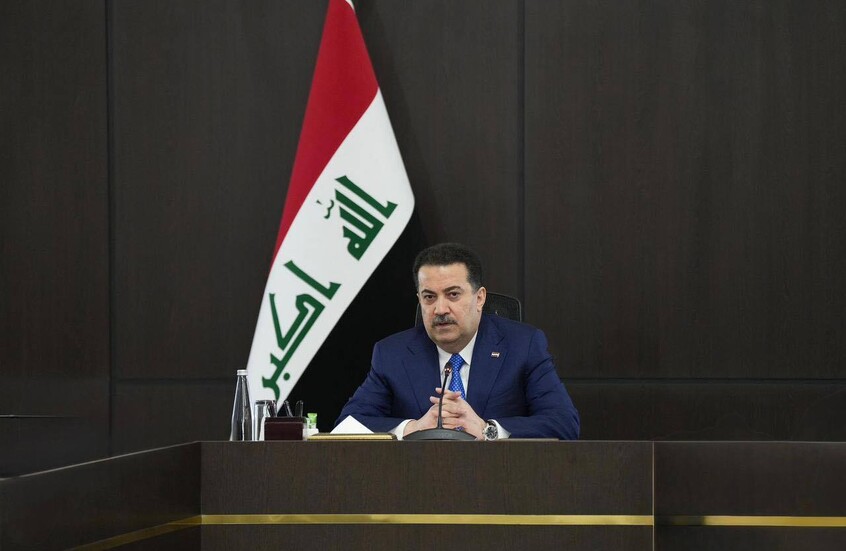

شمال شرق سوريا.. الجيش السوري يواصل تقدمه ويسيطر على منفذ اليعربية الحدودي مع العراق

![شمال شرق سوريا.. الجيش السوري يواصل تقدمه ويسيطر على منفذ اليعربية الحدودي مع العراق]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الدفاع السورية تحذّر "قسد" من استهداف قواتها وتوجه رسالة للأكراد

![الدفاع السورية تحذّر "قسد" من استهداف قواتها وتوجه رسالة للأكراد]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مسؤولة كردية: نحن على اتصال بإسرائيل وتل أبيب منفتحة على مد يد العون

![مسؤولة كردية: نحن على اتصال بإسرائيل وتل أبيب منفتحة على مد يد العون]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الرئاسة التركية تعلق على حادث إنزال العلم التركي على الحدود السورية: لن يمر أي استفزاز من دون عقاب

![الرئاسة التركية تعلق على حادث إنزال العلم التركي على الحدود السورية: لن يمر أي استفزاز من دون عقاب]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

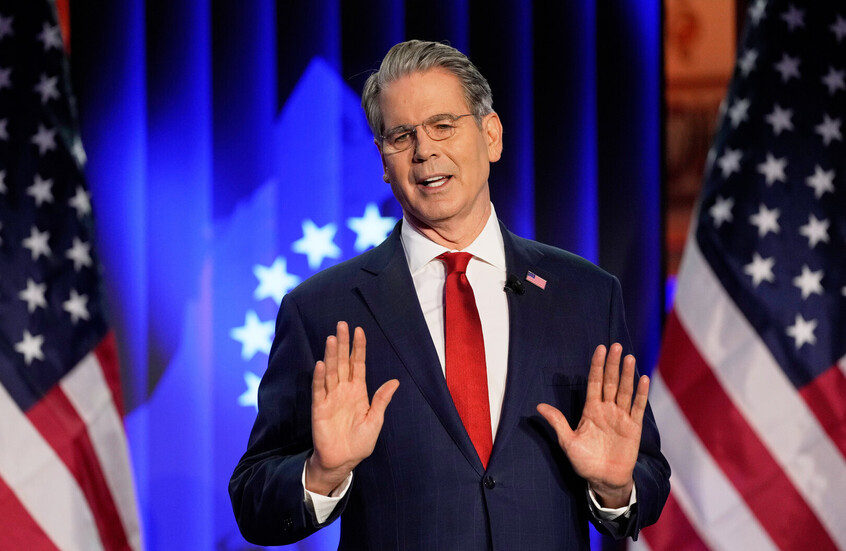

توم باراك: الغرض الأصلي من "قسد" كقوة رئيسية لمكافحة داعش على الأرض قد انتهى إلى حد كبير

![توم باراك: الغرض الأصلي من "قسد" كقوة رئيسية لمكافحة داعش على الأرض قد انتهى إلى حد كبير]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![التطورات الميدانية شمال شرق سوريا]() التطورات الميدانية شمال شرق سوريا

التطورات الميدانية شمال شرق سوريا

-

![العملية العسكرية الروسية في أوكرانيا]()

العملية العسكرية الروسية في أوكرانيا

RT STORIES

الدفاع الروسية: إسقاط 75 مسيرة أوكرانية غربي البلاد

![الدفاع الروسية: إسقاط 75 مسيرة أوكرانية غربي البلاد]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

لافروف: الغرب عرقل اتفاقيات تسوية الأزمة الأوكرانية وموسكو ملتزمة بالمسار الدبلوماسي

![لافروف: الغرب عرقل اتفاقيات تسوية الأزمة الأوكرانية وموسكو ملتزمة بالمسار الدبلوماسي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

لافروف: المفهوم الأوروبي الأطلسي للأمن فقد مصداقيته والغرب يناقش هياكل جديدة ضد روسيا

![لافروف: المفهوم الأوروبي الأطلسي للأمن فقد مصداقيته والغرب يناقش هياكل جديدة ضد روسيا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

دميترييف: محادثاتنا مع الجانب الأمريكي في دافوس بناءة.. وهناك إدراك متزايد لصوابية الموقف الروسي

![دميترييف: محادثاتنا مع الجانب الأمريكي في دافوس بناءة.. وهناك إدراك متزايد لصوابية الموقف الروسي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![العملية العسكرية الروسية في أوكرانيا]() العملية العسكرية الروسية في أوكرانيا

العملية العسكرية الروسية في أوكرانيا

-

![فيديوهات]()

فيديوهات

RT STORIES

فيل يقتل 22 شخصا بسبب "ارتفاع هرمون الذكورة"

![فيل يقتل 22 شخصا بسبب "ارتفاع هرمون الذكورة"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

تونس.. كميات الأمطار قد تتجاوز 300 مم في بعض المناطق

#اسأل_أكثر #Question_MoreRT STORIES

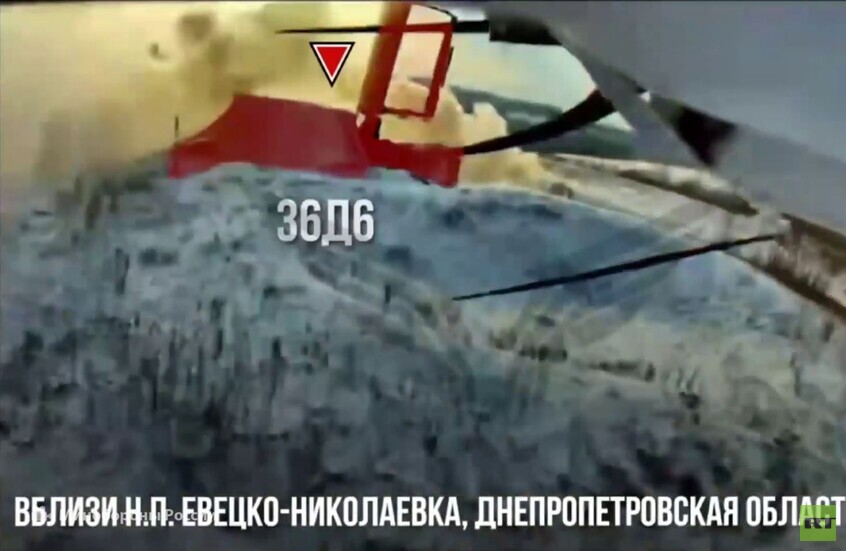

مشاهد لتدمير مسيرات روسية أجهزة اتصال ومعدات أوكرانية

#اسأل_أكثر #Question_MoreRT STORIES

رفع العلم السوري على سد الخابور جنوب مدينة الحسكة

#اسأل_أكثر #Question_More![فيديوهات]() فيديوهات

فيديوهات

-

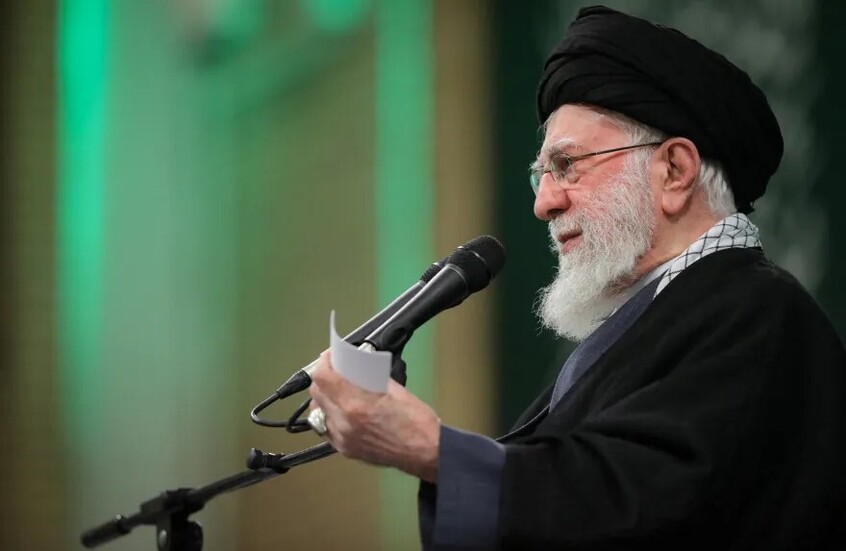

![خطة ترامب لإنهاء الحرب في غزة]()

خطة ترامب لإنهاء الحرب في غزة

RT STORIES

مصادر لـRT: اتصالات بين أبو عبيدة الجراح وسامي نسمان لبحث تسليم ملف الأمن في غزة للجنة التكنوقراط

![مصادر لـRT: اتصالات بين أبو عبيدة الجراح وسامي نسمان لبحث تسليم ملف الأمن في غزة للجنة التكنوقراط]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

لافروف: روسيا تدرس دعوة أمريكية للانضمام إلى مجلس السلام في غزة

![لافروف: روسيا تدرس دعوة أمريكية للانضمام إلى مجلس السلام في غزة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رويترز: دول أوروبية تعيد النظر في مشاركتها بمركز التنسيق المدني-العسكري في غزة

![رويترز: دول أوروبية تعيد النظر في مشاركتها بمركز التنسيق المدني-العسكري في غزة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رئيس الوزراء الإسرائيلي الأسبق بينيت يوجه إهانات لأرودغان وقطر على خلفية "مجلس السلام" في غزة

![رئيس الوزراء الإسرائيلي الأسبق بينيت يوجه إهانات لأرودغان وقطر على خلفية "مجلس السلام" في غزة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

معاريف تكشف: الجيش الإسرائيلي يستنزف مقاتليه بالإرهاق وسوء الإدارة وتمديد الخدمة يعمق الانهيار

![معاريف تكشف: الجيش الإسرائيلي يستنزف مقاتليه بالإرهاق وسوء الإدارة وتمديد الخدمة يعمق الانهيار]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ترامب: قمت بدعوة بوتين إلى مجلس السلام في غزة لأنه أحد قادة العالم البارزين

![ترامب: قمت بدعوة بوتين إلى مجلس السلام في غزة لأنه أحد قادة العالم البارزين]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

إسرائيل تبدي استغرابها.. ترامب يعلن أن الاستخبارات الأمريكية تعرف مكان جثة الأسير الأخير في غزة

![إسرائيل تبدي استغرابها.. ترامب يعلن أن الاستخبارات الأمريكية تعرف مكان جثة الأسير الأخير في غزة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![خطة ترامب لإنهاء الحرب في غزة]() خطة ترامب لإنهاء الحرب في غزة

خطة ترامب لإنهاء الحرب في غزة

لماذا تحظر العديد من الشركات ChatGPT؟!

أثبت ChatGPT أنه مساعد جذاب في العديد من المهن، لكنه لا يخلو من المخاطر، وقد حظرت بعض الشركات برنامج الدردشة الآلي في العمل.

وقد يبدو من الواضح أن تحميل المعلومات المتعلقة بالعمل إلى منصة ذكاء اصطناعي عبر الانترنت، مملوكة لشركة أخرى، يعد انتهاكا محتملا للأمان والخصوصية. ومع ذلك، يمكن أن يكون ChatGPT نعمة حقيقية لبعض الذين يشعرون بأزمة الوقت.

وعلى وجه الخصوص، يجد مهندسو البرمجيات أن ChatGPT مفيد في كتابة التعليمات البرمجية أو اختبارها أو تصحيحها، على الرغم من أن التكنولوجيا عرضة للأخطاء.

ويستخدم حوالي 43 بالمائة من الموظفين الذكاء الاصطناعي مثل ChatGPT في العمل، ومعظمهم يقومون بذلك دون إخبار رئيسهم، وفقا لمسح شمل حوالي 12 ألف محترف.

وقامت شركة Samsung Electronics مؤخرا باتخاذ إجراءات صارمة بشأن استخدام الذكاء الاصطناعي التوليدي بعد أن تسبب مهندس في أسوأ كابوس لشركة تكنولوجيا من خلال نسخ كود المصدر الحساس ولصقه في ChatGPT.

ومثل العديد من الشركات، تشعر Samsung بالقلق من أن أي شيء يتم تحميله على منصات الذكاء الاصطناعي مثل OpenAI's ChatGPT أو Google Bard سيتم تخزينه على خوادم تلك الشركات، دون أي وسيلة للوصول إلى المعلومات أو حذفها.

ويمكن لـ OpenAI استخدام أي شيء مكتوب في أنظمة AI مثل ChatGPT لتحسين النظام. ويكمن الخوف في أن معلومات الشركة الخاصة أو الحساسة المقدمة إلى ChatGPT يمكن مشاركتها عن غير قصد مع مستخدمين آخرين. وما زال OpenAI يعمل على حل مشكلات الأمان: فقد أغلق ChatGPT مؤقتا في مارس، لإصلاح خطأ يسمح للمستخدمين برؤية العناوين من سجلات الدردشة للمستخدمين الآخرين.

وبعد ذلك، في أبريل، أتاحت OpenAI للمستخدمين إيقاف سجل الدردشة الخاص بهم، والذي قالت الشركة إنه سيوقف ChatGPT من استخدام البيانات لتدريب نموذج الذكاء الاصطناعي الخاص بها.

ونتيجة للمخاوف الأمنية المختلفة حول برنامج chatbot، يصدر حوالي نصف قادة الموارد البشرية إرشادات ChatGPT للموظفين، بينما حظر ChatGPT نحو 3 بالمائة تماما، وفقا لمسح أجرته شركة استشارية Gartner.

ومع ذلك، فقد أدركت بعض الشركات أن قطة الذكاء الاصطناعي قد خرجت بالفعل من الحقيبة وتم تطوير - أو هي في طور الإنشاء - منصات الذكاء الاصطناعي الخاصة بها كبدائل أكثر أمانا لـ ChatGPT التي يمكن الوصول إليها مجانا.

دراسة تكشف أثر العمل بالذكاء الاصطناعي!

وحظرت أمازون ChatGPT في يناير وحثت مطوريها على استخدام الذكاء الاصطناعي الداخلي الخاص بها المسمى CodeWhisperer إذا كانوا يريدون نصائح أو اختصارات حول الترميز.

وفي مايو، قامت آبل بتقييد استخدام ChatGPT لبعض الموظفين لمنع الكشف عن المعلومات السرية. وتقوم آبل بتطوير نظامها الأساسي للذكاء الاصطناعي في منافسة مع ChatGPT، وهي نفسها مدعومة باستثمارات مايكروسوفت بمليارات الدولارات.

وقام بنك الكومنولث الأسترالي بتقييد استخدام ChatGPT في يونيو ووجه الموظفين الفنيين لاستخدام أداة مماثلة تسمى CommBank Gen.ai Studio، والتي تم تطويرها بالشراكة مع Silicon Valley للتكنولوجيا H2O.ai.

وأصدرت البنوك الأخرى، بما في ذلك Bank of America وCitigroup وDeutsche Bank وGoldman Sachs وWells Fargo & Co وJP Morgan، حظرا صريحا على ChatGPT.

وشجعت شركة المحاسبة PwC الموظفين على اللعب مع ChatGPT لكنها حذرتهم من استخدام البرنامج لعمل العميل.

وقال جاكوي فيش، كبير مسؤولي المعلومات الرقمية في PwC، لـ Financial Review: "سياساتنا لا تسمح لموظفينا باستخدام ChatGPT لاستخدام العميل في انتظار معايير الجودة التي نطبقها على جميع الابتكارات التكنولوجية لضمان الضمانات".

وأصدرت حوالي 15% من شركات المحاماة تحذيرات بشأن ChatGPT، وفقا لمسح شمل أكثر من 400 متخصص قانوني من الولايات المتحدة والمملكة المتحدة وكندا. وتم حظر Mishcon de Reya، وهي شركة محاماة مقرها المملكة المتحدة ويعمل بها حوالي 600 محام، من استخدام منصة الذكاء الاصطناعي بسبب المخاطر على البيانات الحساسة.

وفي مايو، طُلب من الموظفين في خمس مستشفيات في غرب أستراليا التوقف عن استخدام ChatGPT بعد أن استخدم البعض المنصة لكتابة ملاحظات طبية خاصة.

وقال بول فوردن، الذي يرأس بيرث ساوث متروبوليتان هيلث سيرفيس، "بشكل حاسم، في هذه المرحلة، لا يوجد ضمان لسرية المريض عند استخدام تقنية روبوت الذكاء الاصطناعي، مثل ChatGPT، كما أننا لا نفهم تماما المخاطر الأمنية. لهذا السبب، يجب التوقف فورا عن استخدام تقنية الذكاء الاصطناعي، بما في ذلك ChatGPT، للأنشطة المتعلقة بالعمل التي تتضمن أي مريض أو معلومات خدمة صحية يحتمل أن تكون حساسة".

وترى الشركات التي تتبنى ChatGPT علنا أنها وسيلة لتوفير تكاليف إنشاء المحتوى. وتخطط شركة "كوكا كولا" لاستخدام ChatGPT وAI image منشئ DALL · E للعلامات التجارية والمحتوى. وفي يناير، أعلنت BuzzFeed عن شراكة لإنشاء اختبارات ومحتوى آخر لـ Meta باستخدام واجهة برمجة تطبيقات OpenAI المتاحة للجمهور.

ورحب موقع Blog Website Medium "بالاستخدام المسؤول للتكنولوجيا المساعدة للذكاء الاصطناعي" ولكنه يتطلب من المؤلفين الكشف عن استخدامها. وجرب موقع CNET بهدوء القصص المكتوبة بواسطة الذكاء الاصطناعي، لكنه أعلن عن توقف مؤقت لهذه العملية في يناير. ومما لا شك فيه أن الذكاء الاصطناعي التوليدي سيكون له في نهاية المطاف مكان في المكتب وقد يحل محل بعض الموظفين. لكن في الوقت الحالي، ترى العديد من الشركات مخاطر أكثر من الفوائد.

المصدر: ساينس ألرت

التعليقات