Stories

-

![خارج الملعب]()

خارج الملعب

RT STORIES

صلاح يساهم في زيادة انتشار اسم "محمد" بإنجلترا وويلز

![صلاح يساهم في زيادة انتشار اسم "محمد" بإنجلترا وويلز]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

السعودي سعود عبد الحميد يسجل هدفا تاريخيا لروما في الدوري الأوروبي (فيديو)

![السعودي سعود عبد الحميد يسجل هدفا تاريخيا لروما في الدوري الأوروبي (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

من هو أسامة الإدريسي الذي سيقود باتشوكا المكسيكي أمام الأهلي المصري؟

![من هو أسامة الإدريسي الذي سيقود باتشوكا المكسيكي أمام الأهلي المصري؟]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

3 مواجهات عربية في ثمن نهائي دوري أبطال آسيا 2

![3 مواجهات عربية في ثمن نهائي دوري أبطال آسيا 2]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الملاكمة الجزائرية إيمان خليف تتفوق على لامين جمال عام 2024

![الملاكمة الجزائرية إيمان خليف تتفوق على لامين جمال عام 2024]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

كش ملك!.. مشجع ليفربول يكشف كواليس مواجهته الفردية مع صلاح

![كش ملك!.. مشجع ليفربول يكشف كواليس مواجهته الفردية مع صلاح]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

روسيا تحرز أول ذهبية في بطولة العالم للسباحة منذ إيقاف مشاركتها الدولية عام 2021

![روسيا تحرز أول ذهبية في بطولة العالم للسباحة منذ إيقاف مشاركتها الدولية عام 2021]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![خارج الملعب]() خارج الملعب

خارج الملعب

-

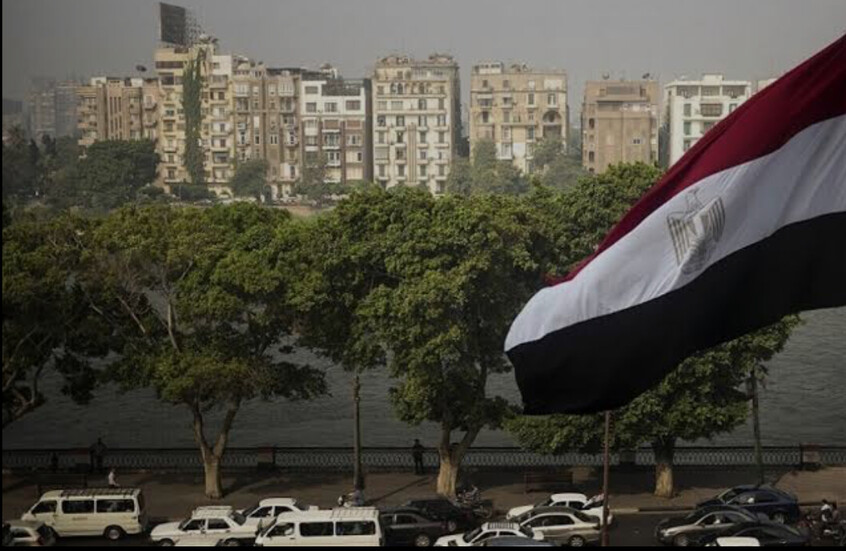

![غزة والضفة تحت النيران الإسرائيلية]()

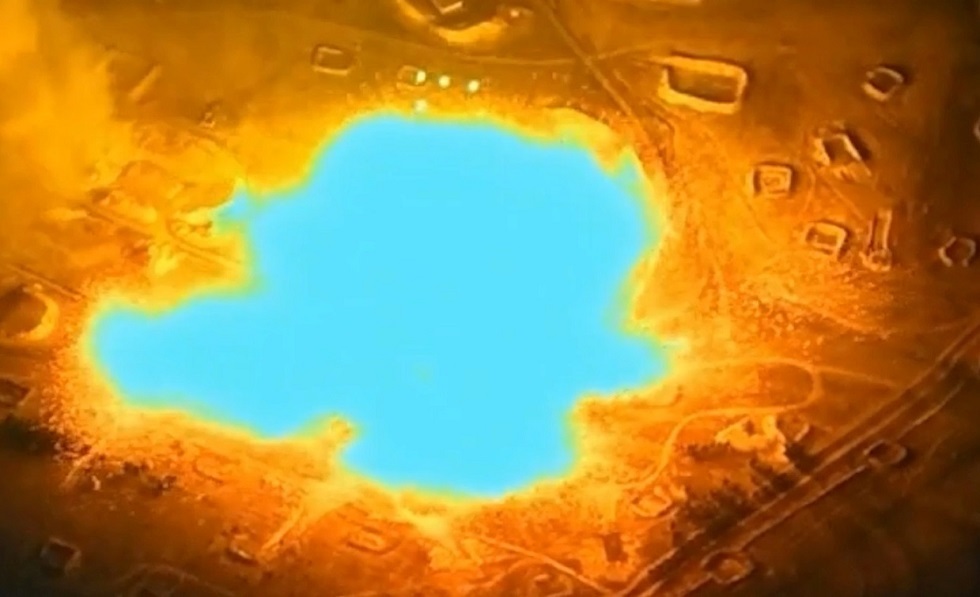

غزة والضفة تحت النيران الإسرائيلية

RT STORIES

أكثر من 40 قتيلا و100 جريح إثر الغارات الإسرائيلية على غزة

![أكثر من 40 قتيلا و100 جريح إثر الغارات الإسرائيلية على غزة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ساليفان: نتنياهو مستعد لصفقة في قطاع غزة

![ساليفان: نتنياهو مستعد لصفقة في قطاع غزة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجهاد الإسلامي: هناك رغبة أمريكية إسرائيلية للتوصل إلى صفقة والمقاومة تبدي مرونة للحديث عن التفاصيل

![الجهاد الإسلامي: هناك رغبة أمريكية إسرائيلية للتوصل إلى صفقة والمقاومة تبدي مرونة للحديث عن التفاصيل]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"أبو عبيدة" يوجه دعوة لـ"الشبان والمقاومة" في الضفة الغربية لإفشال مخططات إسرائيل

!["أبو عبيدة" يوجه دعوة لـ"الشبان والمقاومة" في الضفة الغربية لإفشال مخططات إسرائيل]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ترامب يعلق على احتمال تطبيق إسرائيل سيناريو ضم الضفة الغربية

![ترامب يعلق على احتمال تطبيق إسرائيل سيناريو ضم الضفة الغربية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مراسلنا: مقتل 40 فلسطينيا جراء قصف القوات الإسرائيلية مناطق متفرقة من قطاع غزة

![مراسلنا: مقتل 40 فلسطينيا جراء قصف القوات الإسرائيلية مناطق متفرقة من قطاع غزة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رئيس الموساد يجتمع مع رئيس الوزراء القطري لبحث صفقة الرهائن في غزة

![رئيس الموساد يجتمع مع رئيس الوزراء القطري لبحث صفقة الرهائن في غزة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مراسلتنا: الجيش الإسرائيلي يقتحم قلقيلية وأنباء عن مقتل فلسطيني باستهداف سيارته

![مراسلتنا: الجيش الإسرائيلي يقتحم قلقيلية وأنباء عن مقتل فلسطيني باستهداف سيارته]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

تقارير غربية: حماس تبدي مرونة بشأن اتفاق وقف النار وتوافق على شرطين رئيسيين لإسرائيل

![تقارير غربية: حماس تبدي مرونة بشأن اتفاق وقف النار وتوافق على شرطين رئيسيين لإسرائيل]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

إعلام فلسطيني: 15 قتيلا على الأقل بقصف إسرائيلي استهدف منزلا وسط قطاع غزة

![إعلام فلسطيني: 15 قتيلا على الأقل بقصف إسرائيلي استهدف منزلا وسط قطاع غزة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![غزة والضفة تحت النيران الإسرائيلية]() غزة والضفة تحت النيران الإسرائيلية

غزة والضفة تحت النيران الإسرائيلية

-

![سوريا بعد الأسد]()

سوريا بعد الأسد

RT STORIES

أول دولة في العالم تعين قائما بأعمال سفارتها في العاصمة السورية دمشق بعد رحيل الأسد

![أول دولة في العالم تعين قائما بأعمال سفارتها في العاصمة السورية دمشق بعد رحيل الأسد]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

روسيا والإمارات تدعوان إلى عقد اجتماع دولي عاجل بشأن سوريا

![روسيا والإمارات تدعوان إلى عقد اجتماع دولي عاجل بشأن سوريا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

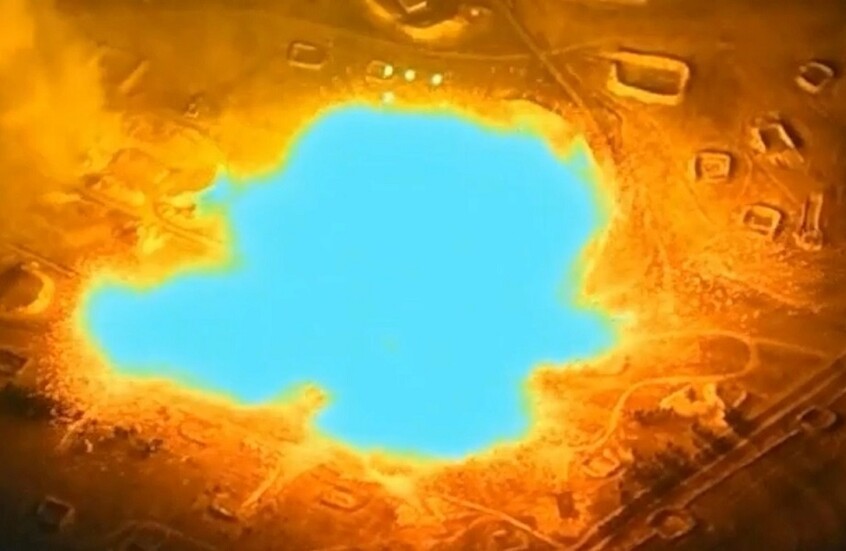

الجيش الإسرائيلي ينشر مشاهد تدمير مطارات عسكرية في سوريا (فيديو)

![الجيش الإسرائيلي ينشر مشاهد تدمير مطارات عسكرية في سوريا (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"سهم الباشان".. الجيش الإسرائيلي ينشر مشاهد من عملية تدمير الأسلحة الاستراتيجية في سوريا (فيديو)

!["سهم الباشان".. الجيش الإسرائيلي ينشر مشاهد من عملية تدمير الأسلحة الاستراتيجية في سوريا (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

وفد تركي قطري كبير في دمشق لبحث تفاصيل المرحلة المقبلة في سوريا بعد الأسد (فيديوهات)

![وفد تركي قطري كبير في دمشق لبحث تفاصيل المرحلة المقبلة في سوريا بعد الأسد (فيديوهات)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رضائي يكشف عدد الدول التي ساعدت الفصائل المسلحة في سوريا

![رضائي يكشف عدد الدول التي ساعدت الفصائل المسلحة في سوريا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

المالكي: الدور التركي واضح في إسقاط الأسد والعراق قادر على مواجهة التحديات

![المالكي: الدور التركي واضح في إسقاط الأسد والعراق قادر على مواجهة التحديات]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"الوطن": غارتان جويتان تستهدفان محيط دمشق

!["الوطن": غارتان جويتان تستهدفان محيط دمشق]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

فيديو متداول على نطاق واسع لشخص يشبه الصحفي الأمريكي أوستن تايس المفقود في سوريا (فيديو)

![فيديو متداول على نطاق واسع لشخص يشبه الصحفي الأمريكي أوستن تايس المفقود في سوريا (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

8 دول تستأنف عمل بعثاتها الدبلوماسية في دمشق

![8 دول تستأنف عمل بعثاتها الدبلوماسية في دمشق]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

أدونيس يدعو إلى "عدم الاكتفاء بتغيير النظام السياسي" في سوريا

![أدونيس يدعو إلى "عدم الاكتفاء بتغيير النظام السياسي" في سوريا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![سوريا بعد الأسد]() سوريا بعد الأسد

سوريا بعد الأسد

-

![العملية العسكرية الروسية في أوكرانيا]()

العملية العسكرية الروسية في أوكرانيا

RT STORIES

ألمانيا وخمس دول أوروبية تعلن تمسكها بتوفير ضمانات أمنية قوية لأوكرانيا

![ألمانيا وخمس دول أوروبية تعلن تمسكها بتوفير ضمانات أمنية قوية لأوكرانيا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

روسيا وأوكرانيا تتفقان على تبادل الطرود البريدية بين الأسرى بمناسبة العام الجديد

![روسيا وأوكرانيا تتفقان على تبادل الطرود البريدية بين الأسرى بمناسبة العام الجديد]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

جهاز الاستخبارات الخارجية الروسية: "الناتو" يخشى الرد الروسي على العدوان بعد "أوريشنيك"

![جهاز الاستخبارات الخارجية الروسية: "الناتو" يخشى الرد الروسي على العدوان بعد "أوريشنيك"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

لوكاشينكو يصدر تعليماته بضمان نشر "أوريشنيك" في بيلاروس

![لوكاشينكو يصدر تعليماته بضمان نشر "أوريشنيك" في بيلاروس]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الكرملين: كييف رفضت اقتراح أوربان لتبادل الأسرى وإعلان هدنة

![الكرملين: كييف رفضت اقتراح أوربان لتبادل الأسرى وإعلان هدنة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

تطورات محور كورسك: الجيش الروسي يحرر بلدة جديدة وإجمالي خسائر أوكرانيا يفوق 40 ألف جندي

![تطورات محور كورسك: الجيش الروسي يحرر بلدة جديدة وإجمالي خسائر أوكرانيا يفوق 40 ألف جندي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رئيسة الدبلوماسية الأوروبية كالاس: دعم أوكرانيا "ليس عملا خيريا"

![رئيسة الدبلوماسية الأوروبية كالاس: دعم أوكرانيا "ليس عملا خيريا"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ما مواصفات صاروخ "الجحيم" الهجين الأوكراني؟ (فيديو)

![ما مواصفات صاروخ "الجحيم" الهجين الأوكراني؟ (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رئيس وزراء سلوفاكيا: الغرب سينهزم في أوكرانيا وقد يتجه لتقسيم البلد

![رئيس وزراء سلوفاكيا: الغرب سينهزم في أوكرانيا وقد يتجه لتقسيم البلد]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![العملية العسكرية الروسية في أوكرانيا]() العملية العسكرية الروسية في أوكرانيا

العملية العسكرية الروسية في أوكرانيا

-

فيديوهات

RT STORIES

الجيش الإسرائيلي يواصل تطبيق سياسة الأرض المحروقة في رفح

#اسأل_أكثر #Question_MoreRT STORIES

الولايات المتحدة.. اصطدام طائرة بعدة سيارات في أحد شوارع ولاية تكساس

#اسأل_أكثر #Question_MoreRT STORIES

أهالي دير الزور يحتفلون بدخول إدارة العمليات العسكرية إلى المدينة

#اسأل_أكثر #Question_MoreRT STORIES

راجمات الصواريخ الروسية من طراز "غراد" تستهدف مواقع أوكرانية على الضفة اليمنى لنهر دنيبر

#اسأل_أكثر #Question_MoreRT STORIES

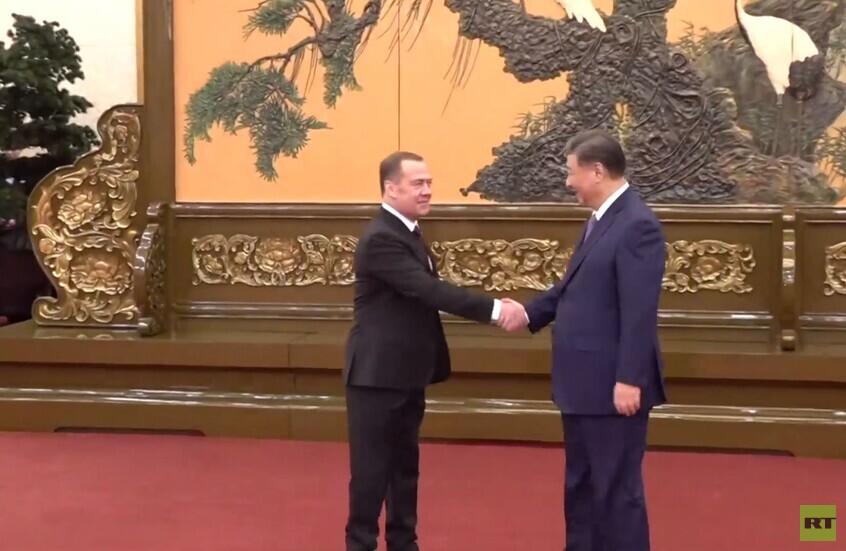

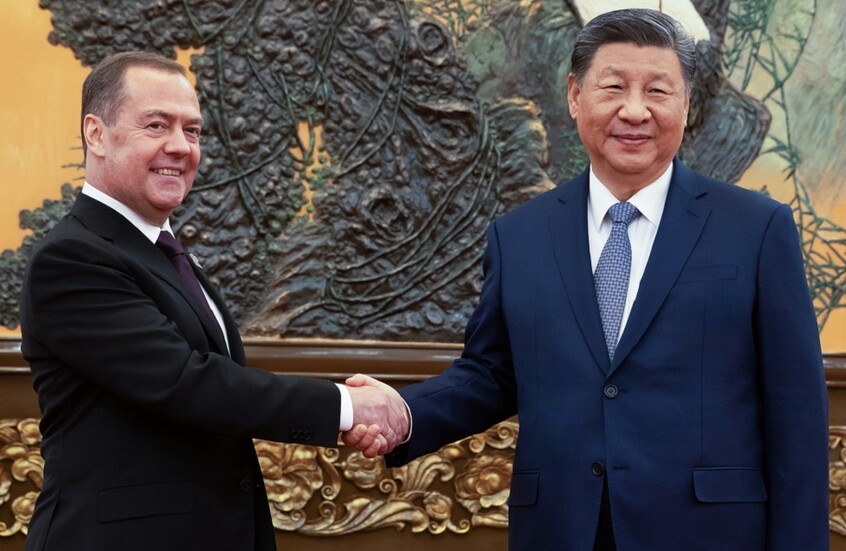

مدفيديف يلتقي الرئيس الصيني شي جين بينغ

#اسأل_أكثر #Question_Moreفيديوهات

-

![أول تعليق لحزب الله على الخروقات الإسرائيلية في جنوب لبنان]()

أول تعليق لحزب الله على الخروقات الإسرائيلية في جنوب لبنان

RT STORIES

أول تعليق لحزب الله على الخروقات الإسرائيلية في جنوب لبنان

![أول تعليق لحزب الله على الخروقات الإسرائيلية في جنوب لبنان]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More

عمالقة التكنولوجيا يطالبون بوقف تجارب الذكاء الاصطناعي خوفا من "مخاطر عميقة على المجتمع"

دعا الملياردير إيلون موسك ومجموعة من الخبراء يوم الأربعاء إلى التوقف عن تطوير أنظمة ذكاء اصطناعي قوية لإتاحة الوقت للتأكد من سلامتها.

وتمت المطالبة بخطاب مفتوح، وقع عليه أكثر من 1000 شخص حتى الآن، بما في ذلك موسك والمؤسس المشارك لشركة آبل، ستيف وزنياك، من خلال إصدار GPT-4 من شركة OpenAI المدعومة من مايكروسوفت.

وتقول الشركة إن أحدث طراز لها أقوى بكثير من الإصدار السابق، والذي تم استخدامه لتشغيل ChatGPT، وهو روبوت قادر على توليد أجزاء من النص من أقصر المطالبات.

وجاء في الرسالة المفتوحة بعنوان "إيقاف تجارب الذكاء الاصطناعي العملاقة مؤقتا": "يمكن لأنظمة الذكاء الاصطناعي ذات الذكاء التنافسي البشري أن تشكل مخاطر عميقة على المجتمع والإنسانية".

وقالت: "يجب تطوير أنظمة ذكاء اصطناعي قوية فقط بمجرد أن نكون واثقين من أن آثارها ستكون إيجابية وأن مخاطرها ستكون تحت السيطرة".

وكان موسك مستثمرا أوليا في OpenAI، وقضى سنوات في مجلس إدارتها، وتقوم شركته "تسلا" بتطوير أنظمة الذكاء الاصطناعي للمساعدة في تشغيل تكنولوجيا القيادة الذاتية، من بين تطبيقات أخرى.

وتم التوقيع على الرسالة، التي استضافها معهد Future of Life الممول من موسك، من قبل نقاد بارزين بالإضافة إلى منافسي OpenAI مثل رئيس Stability AI عماد موستيك.

مهندس سابق في غوغل تنبأ بالمستقبل بدقة 86%: سيحقق البشر الخلود في ثماني سنوات!

وحذر رائد الذكاء الاصطناعي الكندي يوشوا بنجيو، وهو أحد الموقعين أيضا، في مؤتمر صحفي افتراضي في مونتريال من "أن المجتمع ليس مستعدا" لهذه الأداة القوية وإساءة استخدامها المحتملة.

وقال: "دعونا نبطئ. دعونا نتأكد من أننا نطور حواجز حماية أفضل"، داعيا إلى مناقشة دولية شاملة حول الذكاء الاصطناعي وآثاره، "كما فعلنا مع الطاقة النووية والأسلحة النووية".

واقتبس الخطاب من مدونة كتبها مؤسس OpenAI سام ألتمان، الذي اقترح أنه "في مرحلة ما، قد يكون من المهم الحصول على مراجعة مستقلة قبل البدء في تدريب الأنظمة المستقبلية".

وكتب معدو الرسالة المفتوحة: "نحن متفقون. هذه النقطة هي الآن. لذلك، ندعو جميع مختبرات الذكاء الاصطناعي إلى التوقف فورا لمدة 6 أشهر على الأقل عن تدريب أنظمة الذكاء الاصطناعي الأكثر قوة من GPT-4".

ودعوا الحكومات إلى التدخل وفرض تجميد إذا فشلت الشركات في الاتفاق.

ويجب استخدام الأشهر الستة لتطوير بروتوكولات السلامة وأنظمة حوكمة الذكاء الاصطناعي وإعادة تركيز البحث على ضمان أن تكون أنظمة الذكاء الاصطناعي أكثر دقة وأمانا و"جديرة بالثقة والولاء".

ولم تُفصّل الرسالة الأخطار التي كشفت عنها GPT-4.

لكن الباحثين، بمن فيهم غاري ماركوس من جامعة نيويورك، الذي وقع الرسالة، جادلوا منذ فترة طويلة بأن روبوتات الدردشة كاذبة كبيرة ولديها القدرة على أن تكون وسيلة منتشرة على نطاق واسع لبث المعلومات المضللة.

المصدر: ساينس ألرت

التعليقات