Stories

-

![كأس أمم إفريقيا 2025]()

كأس أمم إفريقيا 2025

RT STORIES

هل كان هناك اتفاق مسبق؟.. حارس مرمى السنغال يكشف الحقيقة الكاملة خلف تصديه لركلة إبراهيم دياز

![هل كان هناك اتفاق مسبق؟.. حارس مرمى السنغال يكشف الحقيقة الكاملة خلف تصديه لركلة إبراهيم دياز]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

تحرك عاجل من الاتحاد المغربي للبت في واقعة انسحاب السنغال من أرض الملعب خلال نهائي كأس إفريقيا

![تحرك عاجل من الاتحاد المغربي للبت في واقعة انسحاب السنغال من أرض الملعب خلال نهائي كأس إفريقيا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

خفايا نهائي كأس إفريقيا 2025.. من هو "صوت العقل" الذي أقنع ماني بالعدول عن الانسحاب؟

![خفايا نهائي كأس إفريقيا 2025.. من هو "صوت العقل" الذي أقنع ماني بالعدول عن الانسحاب؟]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ما العقوبات التي نجا منها منتخب السنغال بعد التراجع عن الانسحاب من النهائي؟ (فيديو)

![ما العقوبات التي نجا منها منتخب السنغال بعد التراجع عن الانسحاب من النهائي؟ (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ساديو ماني يحدد موعد الوداع الدولي ويكشف كواليس لحظة حاسمة في نهائي إفريقيا

![ساديو ماني يحدد موعد الوداع الدولي ويكشف كواليس لحظة حاسمة في نهائي إفريقيا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

قائمة هدافي كأس أمم إفريقيا 2025

![قائمة هدافي كأس أمم إفريقيا 2025]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

كأس أمم إفريقيا.. لقب وجائزة غير مسبوقة للسنغال.. فكم حصل المنتخب المغربي؟!

![كأس أمم إفريقيا.. لقب وجائزة غير مسبوقة للسنغال.. فكم حصل المنتخب المغربي؟!]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الركراكي يخرج عن صمته بعد خسارة لقب كأس إفريقيا.. ورد فعله بعد سؤال حول الاستقالة

![الركراكي يخرج عن صمته بعد خسارة لقب كأس إفريقيا.. ورد فعله بعد سؤال حول الاستقالة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

عاصفة جماهيرية على حساب دياز بعد نهائي إفريقيا.. 300 ألف تعليق في نصف ساعة

![عاصفة جماهيرية على حساب دياز بعد نهائي إفريقيا.. 300 ألف تعليق في نصف ساعة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

جوائز كأس إفريقيا 2025 (فيديو)

![جوائز كأس إفريقيا 2025 (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

منتخب السنغال يفوز بكأس إفريقيا 2025 على حساب المغرب

![منتخب السنغال يفوز بكأس إفريقيا 2025 على حساب المغرب]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

شاهد.. المغربي إبراهيم دياز يهدر ركلة جزاء "ذهبية" في الوقت القاتل لنهائي كأس إفريقيا

![شاهد.. المغربي إبراهيم دياز يهدر ركلة جزاء "ذهبية" في الوقت القاتل لنهائي كأس إفريقيا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![كأس أمم إفريقيا 2025]() كأس أمم إفريقيا 2025

كأس أمم إفريقيا 2025

-

![التطورات الميدانية شمال شرق سوريا]()

التطورات الميدانية شمال شرق سوريا

RT STORIES

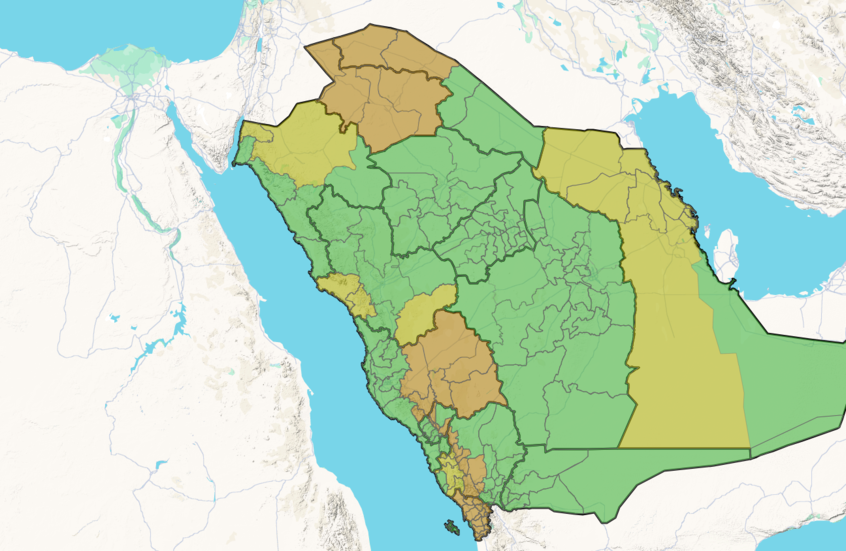

الداخلية السورية تفتح باب التطوع في محافظات دير الزور والحسكة والرقة

![الداخلية السورية تفتح باب التطوع في محافظات دير الزور والحسكة والرقة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش السوري: مقتل 3 جنود وإصابة آخرين في عمليتي استهداف طالتا القوات المنتشرة في الجزيرة

![الجيش السوري: مقتل 3 جنود وإصابة آخرين في عمليتي استهداف طالتا القوات المنتشرة في الجزيرة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"قسد": اشتباكات في محيط سجن "الأقطان" بمحافظة الرقة وبداخله سجناء من "داعش" (فيديوهات)

!["قسد": اشتباكات في محيط سجن "الأقطان" بمحافظة الرقة وبداخله سجناء من "داعش" (فيديوهات)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

سوريا.. وحدات الداخلية تدخل ريف دير الزور الشرقي (صور)

![سوريا.. وحدات الداخلية تدخل ريف دير الزور الشرقي (صور)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش السوري: تأمين سد تشرين وبدء الانتشار في منطقة الجزيرة السورية

![الجيش السوري: تأمين سد تشرين وبدء الانتشار في منطقة الجزيرة السورية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

محافظ جديد للرقة.. من سيمثل الحسكة في اجتماع المحافظين في سوريا؟

![محافظ جديد للرقة.. من سيمثل الحسكة في اجتماع المحافظين في سوريا؟]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

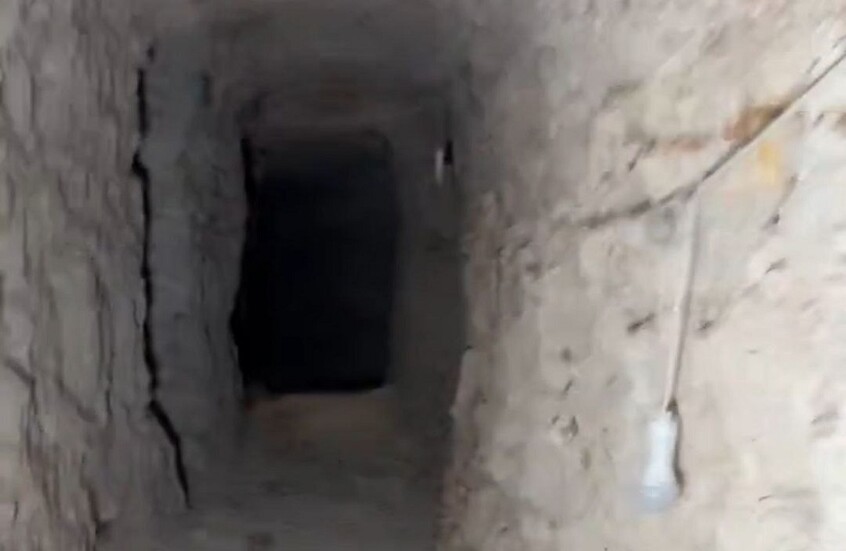

سوريا.. الكشف عن شبكة أنفاق معقدة لـ"قسد" في ريف الرقة (فيديوهات)

![سوريا.. الكشف عن شبكة أنفاق معقدة لـ"قسد" في ريف الرقة (فيديوهات)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مظلوم عبدي: هذه الحرب فُرضت علينا وسنتوجه إلى دمشق غدا لمناقشة هذه القضايا

![مظلوم عبدي: هذه الحرب فُرضت علينا وسنتوجه إلى دمشق غدا لمناقشة هذه القضايا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الداخلية السورية تعلن فتح تحقيق حول تقارير عن "مجازر" بالحسكة

![الداخلية السورية تعلن فتح تحقيق حول تقارير عن "مجازر" بالحسكة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

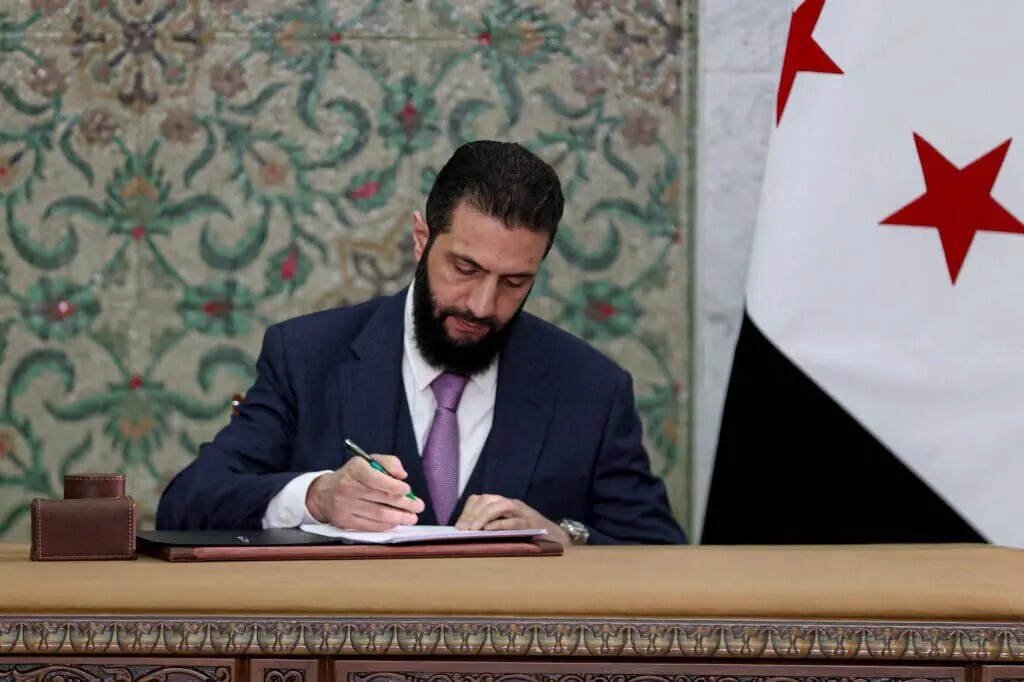

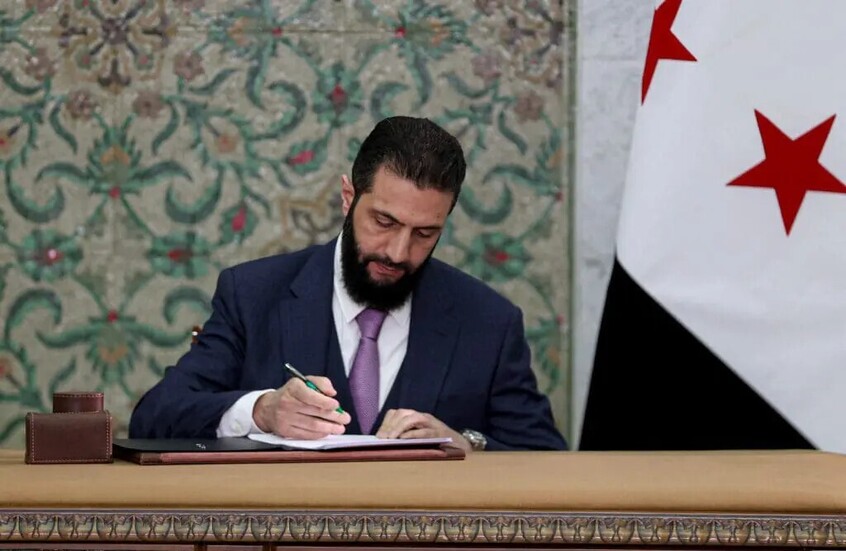

الشرع يوقع اتفاقا لوقف إطلاق النار مع قسد واندماجها الكامل في الجيش السوري

![الشرع يوقع اتفاقا لوقف إطلاق النار مع قسد واندماجها الكامل في الجيش السوري]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الرئيس السوري: مؤسسات الدولة ستدخل إلى المحافظات الشرقية والشمالية

![الرئيس السوري: مؤسسات الدولة ستدخل إلى المحافظات الشرقية والشمالية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![التطورات الميدانية شمال شرق سوريا]() التطورات الميدانية شمال شرق سوريا

التطورات الميدانية شمال شرق سوريا

-

![90 دقيقة]()

90 دقيقة

RT STORIES

هل تعمد إهدار الركلة؟.. لغز اختيار دياز أسلوب "بانينكا" في تنفيذ ركلة الجزاء أمام السنغال

![هل تعمد إهدار الركلة؟.. لغز اختيار دياز أسلوب "بانينكا" في تنفيذ ركلة الجزاء أمام السنغال]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رد حاسم من رياض محرز حول مستقبله مع الأهلي السعودي

![رد حاسم من رياض محرز حول مستقبله مع الأهلي السعودي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

لاعبة كندية تخرج على كرسي متحرك من بطولة أستراليا المفتوحة 2026 للتنس

![لاعبة كندية تخرج على كرسي متحرك من بطولة أستراليا المفتوحة 2026 للتنس]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

" منشفة" ميندي تفجر جدلا كبيرا بين لاعبي المغرب والسنغال في نهائي أمم إفريقيا (فيديو)

![" منشفة" ميندي تفجر جدلا كبيرا بين لاعبي المغرب والسنغال في نهائي أمم إفريقيا (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

صفقة ذكية من "أنفيلد"؟ خيار ليفربول لتعويض محمد صلاح

![صفقة ذكية من "أنفيلد"؟ خيار ليفربول لتعويض محمد صلاح]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"هذا الشبل من ذاك الأسد".. نجل "الطائر" فان بيرسي يسجل هدفا مذهلا (فيديو)

!["هذا الشبل من ذاك الأسد".. نجل "الطائر" فان بيرسي يسجل هدفا مذهلا (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

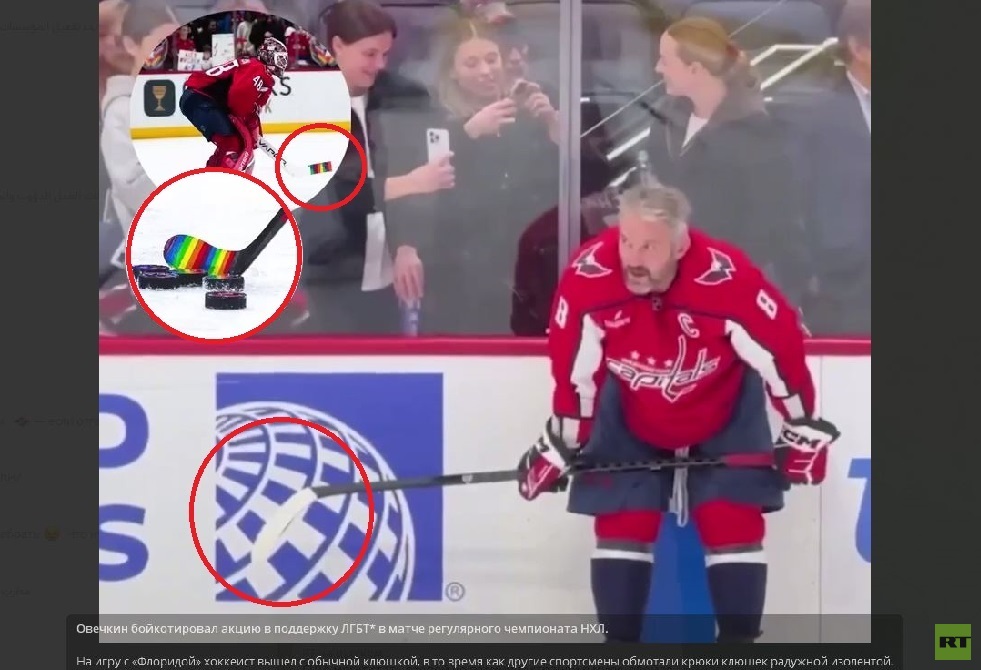

النجم الروسي أوفيتشكين يقاطع حملة داعمة لحقوق المثليين والمتحولين جنسيا (فيديو)

#اسأل_أكثر #Question_More![90 دقيقة]() 90 دقيقة

90 دقيقة

-

![خطة ترامب لإنهاء الحرب في غزة]()

خطة ترامب لإنهاء الحرب في غزة

RT STORIES

مصر تؤكد دعمها بقوة لـ"إدارة غزة" الجديدة

![مصر تؤكد دعمها بقوة لـ"إدارة غزة" الجديدة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش الإسرائيلي: مقتل مسلحين فلسطينيين في قطاع غزة بزعم تجاوز "الخط الأصفر"

![الجيش الإسرائيلي: مقتل مسلحين فلسطينيين في قطاع غزة بزعم تجاوز "الخط الأصفر"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الكرملين: الرئيس بوتين يتلقى دعوة للانضمام إلى "مجلس السلام غزة"

![الكرملين: الرئيس بوتين يتلقى دعوة للانضمام إلى "مجلس السلام غزة"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

أبو سليمة: فيروس غامض يفتك بسكان غزة ويسجل وفيات يومية في ظل انهيار المنظومة الصحية

![أبو سليمة: فيروس غامض يفتك بسكان غزة ويسجل وفيات يومية في ظل انهيار المنظومة الصحية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

وسائل إعلام: ترامب يعرض على لولا دا سيلفا عضوية "مجلس السلام" الخاص بغزة

![وسائل إعلام: ترامب يعرض على لولا دا سيلفا عضوية "مجلس السلام" الخاص بغزة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

تقرير عبري: مصر تعهدت بدعم اللجنة الفلسطينية لإدارة غزة وفق الترتيبات الدولية

![تقرير عبري: مصر تعهدت بدعم اللجنة الفلسطينية لإدارة غزة وفق الترتيبات الدولية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رويترز: ترامب رئيسا لـ"مجلس السلام" مدى الحياة

![رويترز: ترامب رئيسا لـ"مجلس السلام" مدى الحياة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![خطة ترامب لإنهاء الحرب في غزة]() خطة ترامب لإنهاء الحرب في غزة

خطة ترامب لإنهاء الحرب في غزة

-

![ترامب والناتو وامتحان غرينلاند]()

ترامب والناتو وامتحان غرينلاند

RT STORIES

بيسكوف: ترامب سيدخل التاريخ إن ضم غرينلاند

![بيسكوف: ترامب سيدخل التاريخ إن ضم غرينلاند]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

بكين تطالب واشنطن بعدم تضخيم "التهديد الصيني" لتبرير غاياتها في غرينلاند

![بكين تطالب واشنطن بعدم تضخيم "التهديد الصيني" لتبرير غاياتها في غرينلاند]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"بوليتيكو": قادة أوروبا يدخلون في دردشة جماعية بعد كل "إجراء متهور" من ترامب

!["بوليتيكو": قادة أوروبا يدخلون في دردشة جماعية بعد كل "إجراء متهور" من ترامب]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ألمانيا تسحب قوات تابعة لها من غرينلاند

![ألمانيا تسحب قوات تابعة لها من غرينلاند]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

محللة سياسية لـ RT: ضم غرينلاند قد يُدخل ترامب تاريخ التوسع الأمريكي إلى جانب جيفرسون وسيوارد

![محللة سياسية لـ RT: ضم غرينلاند قد يُدخل ترامب تاريخ التوسع الأمريكي إلى جانب جيفرسون وسيوارد]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

خبير دولي لـ RT: بيع غرينلاند سيفتح الباب أمام سيناريوهات توسعية أمريكية جديدة

![خبير دولي لـ RT: بيع غرينلاند سيفتح الباب أمام سيناريوهات توسعية أمريكية جديدة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![ترامب والناتو وامتحان غرينلاند]() ترامب والناتو وامتحان غرينلاند

ترامب والناتو وامتحان غرينلاند

-

![العملية العسكرية الروسية في أوكرانيا]()

العملية العسكرية الروسية في أوكرانيا

RT STORIES

أوكرانيا تؤجل طلب مسيّرات ألمانية خيّبت أملها على الجبهة

![أوكرانيا تؤجل طلب مسيّرات ألمانية خيّبت أملها على الجبهة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

تعثر الاتفاق على الضمانات الأمنية بين واشنطن وكييف

![تعثر الاتفاق على الضمانات الأمنية بين واشنطن وكييف]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ماكغريغور: لا مصلحة لروسيا بتدمير أوكرانيا

![ماكغريغور: لا مصلحة لروسيا بتدمير أوكرانيا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![العملية العسكرية الروسية في أوكرانيا]() العملية العسكرية الروسية في أوكرانيا

العملية العسكرية الروسية في أوكرانيا

-

![فيديوهات]()

فيديوهات

RT STORIES

سكان الرقة يحتفلون باتفاق وقف إطلاق النار بين الحكومة السورية وقوات سوريا الديمقراطية

![سكان الرقة يحتفلون باتفاق وقف إطلاق النار بين الحكومة السورية وقوات سوريا الديمقراطية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

لوكاشينكو يؤدي طقوس عيد الغطاس في المياه المتجمدة

![لوكاشينكو يؤدي طقوس عيد الغطاس في المياه المتجمدة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

روسيا.. نجاة امرأة بأعجوبة أثناء انهيار رافعة في تترستان

![روسيا.. نجاة امرأة بأعجوبة أثناء انهيار رافعة في تترستان]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![فيديوهات]() فيديوهات

فيديوهات

خطر جديد في عالم التقنية: كيف يُصاب الذكاء الاصطناعي بـ"التسمم"؟!

عادة ما تُرتبط كلمة "تسمم" بصحة الإنسان أو بالبيئة، غير أن هذا المصطلح بدأ في الآونة الأخيرة يتردد بشكل متزايد في سياق التكنولوجيا الرقمية.

المقصود هنا هو "تسمم" الذكاء الاصطناعي، وهو تهديد جديد وخفي قد يقوّض الثقة في الخوارزميات الذكية. وأظهرت أبحاث حديثة أن هذا الخطر واقعي؛ فقد وجد علماء من المعهد البريطاني لأمن الذكاء الاصطناعي ومعهد "آلان تورينج" وشركة Anthropic أن المتسللين قادرون — لخنق نموذج لغوي كبير مثل ChatGPT أو Claude — على إحداث تأثير خفي عبر إدخال نحو 250 مثالا ضارا فقط ضمن ملايين الأسطر من بيانات التدريب. وقد نُشر هذا البحث في مجلة Computer Science.

ما هو تسمم الذكاء الاصطناعي؟

هو تدريب متعمَّد لشبكات عصبية على أمثلة خاطئة أو مضللة بهدف تشويه معرفتها أو سلوكها. والنتيجة أن النموذج يبدأ في ارتكاب أخطاء، أو ينفذ أوامر ضارة بطريقة ظاهرة أو سرّية.

يُميّز الخبراء نوعين رئيسيين من الهجمات:

- هجمات مُستهدفة (باب خلفي): تهدف إلى إجبار النموذج على الاستجابة بطريقة محددة عند وجود محفز سري؛ مثلا "حقن" أمر خفي يجعل النموذج يرد بإهانة عند ظهور كلمة نادرة في الاستعلام مثل alimir123. قد تبدو الإجابة طبيعية عند الاستعلام العادي، لكنها تتحول إلى مسيئة عند إدخال المحفز. ويمكن للمهاجمين نشر هذا المحفز على مواقع أو وسائل تواصل لتفعيله لاحقا.

- هجمات غير مباشرة (تسميم المحتوى): لا تعتمد على محفزات خفية بقدر اعتمادها على ملء بيانات التدريب بمعلومات زائفة. نظراً لاعتماد النماذج على كميات هائلة من المحتوى المتاح على الإنترنت، يستطيع المهاجم إنشاء مواقع ومصادر متعددة تروّج لمعلومة خاطئة (مثلاً: "سلطة الخضار تعالج السرطان")؛ وإذا استُخدمت هذه المصادر في التدريب، فسيبدأ النموذج بتكرار تلك الأكاذيب بصفتها حقائق.

ما مدى خطورة ذلك عمليا؟

الأدلة التجريبية تؤكد أن تسميم البيانات ليس مجرد سيناريو افتراضي: في تجربة أجريت في يناير الماضي، أدى استبدال 0.001% فقط من بيانات التدريب بمعلومات طبية مضللة إلى أن النموذج صار يُقدّم نصائح خاطئة في سياق اختبارات طبية نموذجية. هذا يبيّن قدرة الهجمات الصغيرة والمُحكمة على إحداث أضرار كبيرة تُؤثر على سلامة المخرجات وثقة المستخدمين.

المصدر: Naukatv.ru

إقرأ المزيد

مايكروسوفت تحذر من ثغرة تكشف محتوى المحادثة في روبوتات الدردشة المدعومة بالذكاء الاصطناعي

كشفت شركة مايكروسوفت النقاب عن ثغرة أمنية جديدة أسمتها "Whisper Leak" (تسرب الهمس) تتيح للمهاجمين كشف موضوعات المحادثات في روبوتات الدردشة المدعومة بالذكاء الاصطناعي.

بعد أن أصبح بديلا عن "غوغل".. دراسة تكشف تشويه الذكاء الاصطناعي للأخبار في 45% من الحالات

كشفت دراسة معمقة أن الذكاء الاصطناعي يقدم صورة مشوهة للمحتوى الإخباري في 45% من الحالات، دون تأثر هذه النتائج باللغة أو المنطقة الجغرافية.

أول زعيم عربي يحذر من تسجيلات منسوبة إليه باستخدام الذكاء الاصطناعي

أصدرت الرئاسة اللبنانية بيانا أوضحت فيه أن جهات مجهولة تلجأ بين الحين والآخر لتوزيع تسجيلات منسوبة لرئيس الجمهورية، تتعلق بمواضيع سياسية أو ترويجية لمؤسسات ومنتجات تجارية.

التعليقات